版權說明:本文檔由用戶提供并上傳,收益歸屬內容提供方,若內容存在侵權,請進行舉報或認領

文檔簡介

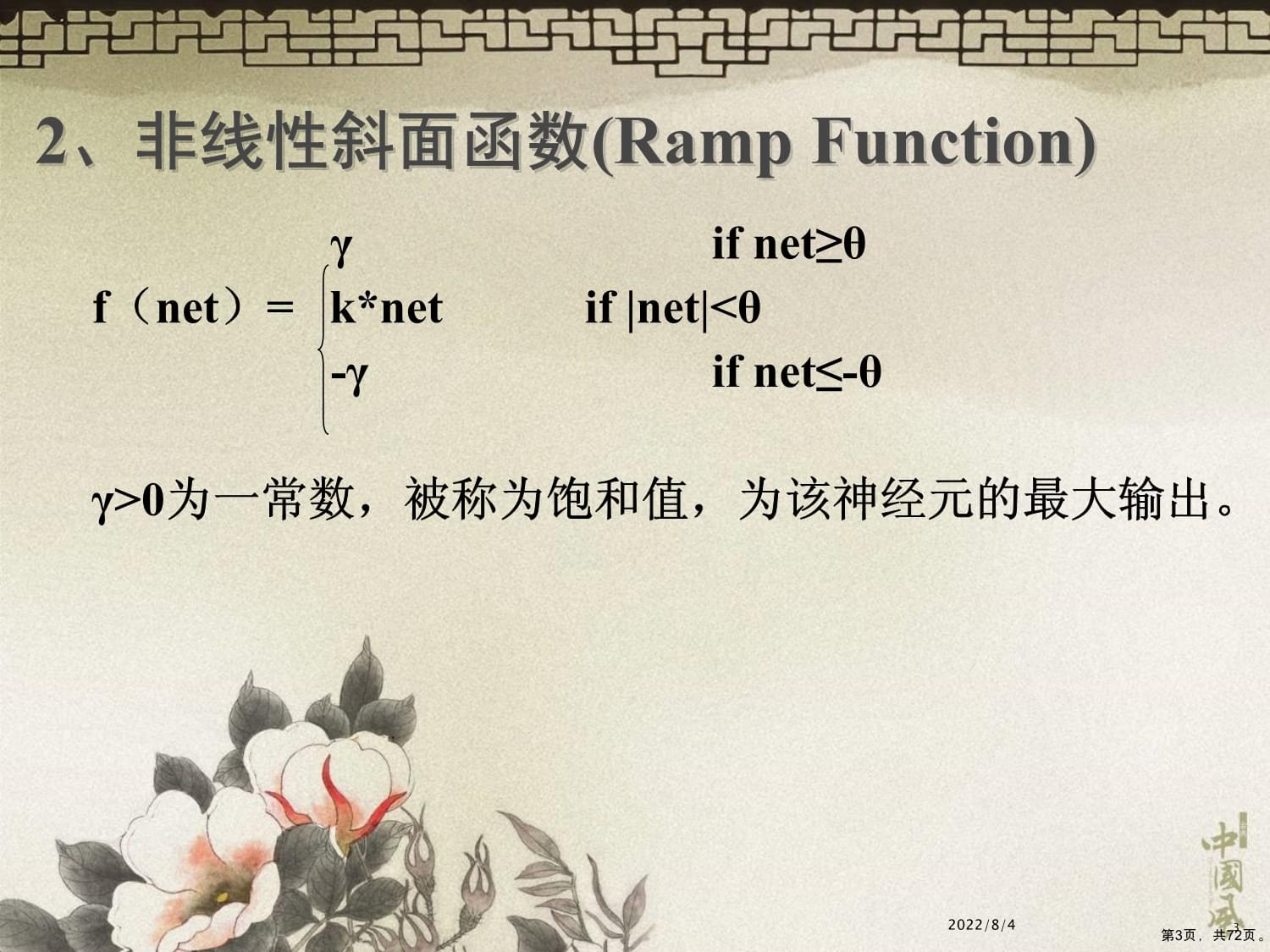

1、人工神經元模擬生物神經元的一階特性。輸入:X=(x1,x2,xn)聯接權:W=(w1,w2,wn)T網絡輸入:net=xiwi向量形式:net=XW2022/8/41人工神經元的基本構成 xn wnx1 w1x2 w2net=XW第1頁,共72頁。激活函數執行對該神經元所獲得的網絡輸入的變換,也可以稱為激勵函數、活化函數: o=f(net) 1、線性函數(Liner Function) f(net)=k*net+c 2022/8/42 激活函數(Activation Function) netooc第2頁,共72頁。 if netf(net)= k*netif |net|0為一常數,被稱為飽和

2、值,為該神經元的最大輸出。 2022/8/432、非線性斜面函數(Ramp Function)第3頁,共72頁。2022/8/442、非線性斜面函數(Ramp Function) - - net o 第4頁,共72頁。if netf(net)=-if net 、均為非負實數,為閾值二值形式:1if netf(net)=0if net 雙極形式:1if netf(net)=-1if net 2022/8/453、閾值函數(Threshold Function)階躍函數第5頁,共72頁。 2022/8/463、閾值函數(Threshold Function)階躍函數-onet0第6頁,共72頁。壓

3、縮函數(Squashing Function)和邏輯斯特函數(Logistic Function)。f(net)=a+b/(1+exp(-d*net)a,b,d為常數。它的飽和值為a和a+b。最簡單形式為:f(net)= 1/(1+exp(-d*net) 函數的飽和值為0和1。S形函數有較好的增益控制 2022/8/474、S形函數 第7頁,共72頁。2022/8/484、S形函數 a+b o(0,c)netac=a+b/2第8頁,共72頁。生物神經網六個基本特征神經元及其聯接、信號傳遞、訓練、刺激與抑制、累積效果、 閾值。人工神經元的基本構成2022/8/49課內容回顧xn wnx1 w1x

4、2 w2net=XW第9頁,共72頁。激活函數與M-P模型 線性函數、非線性斜面函數、閾值函數 S形函數 M-P模型2022/8/410上次課內容回顧x2 w2fo=f(net)xn wnnet=XWx1 w1第10頁,共72頁。2022/8/411簡單單級網x1x2xno1o2omwnmw11w1mw2mwn1輸出層輸入層第11頁,共72頁。W=(wij)輸出層的第j個神經元的網絡輸入記為netj:netj=x1w1j+x2w2j+xnwnj其中, 1 j m。取NET=(net1,net2,netm)NET=XWO=F(NET)2022/8/412簡單單級網第12頁,共72頁。2022/8

5、/413單級橫向反饋網輸出層x1o1w11w1mx2o2w2mxnomwn1輸入層V第13頁,共72頁。V=(vij)NET=XW+OVO=F(NET)時間參數神經元的狀態在主時鐘的控制下同步變化考慮X總加在網上的情況NET(t+1)=X(t)W+O(t)VO(t+1)=F(NET(t+1)O(0)=0考慮僅在t=0時加X的情況。 穩定性判定2022/8/414單級橫向反饋網 第14頁,共72頁。2022/8/415多級網輸出層隱藏層輸入層o1o2omx1x2xn第15頁,共72頁。層次劃分 信號只被允許從較低層流向較高層。層號確定層的高低:層號較小者,層次較低,層號較大者,層次較高。輸入層:

6、被記作第0層。該層負責接收來自網絡外部的信息2022/8/416輸出層隱藏層輸入層o1o2omx1x2xn第16頁,共72頁。第j層:第j-1層的直接后繼層(j0),它直接接受第j-1層的輸出。輸出層:它是網絡的最后一層,具有該網絡的最大層號,負責輸出網絡的計算結果。隱藏層:除輸入層和輸出層以外的其它各層叫隱藏層。隱藏層不直接接受外界的信號,也不直接向外界發送信號2022/8/417輸出層隱藏層輸入層o1o2omx1x2xn第17頁,共72頁。約定 :輸出層的層號為該網絡的層數:n層網絡,或n級網絡。第j-1層到第j層的聯接矩陣為第j層聯接矩陣,輸出層對應的矩陣叫輸出層聯接矩陣。今后,在需要的

7、時候,一般我們用W(j)表示第j層矩陣。2022/8/418輸出層隱藏層輸入層o1o2omx1x2xnW(1)W(2)W(3)W(h)第18頁,共72頁。2022/8/419多級網 層網絡輸出層隱藏層輸入層o1o2omx1x2xnW(1)W(2)W(3)W(h)第19頁,共72頁。非線性激活函數 F(X)=kX+CF3(F2(F1(XW(1)W(2)W(3)2022/8/420多級網第20頁,共72頁。2022/8/421循環網x1o1輸出層隱藏層輸入層x2o2omxn第21頁,共72頁。如果將輸出信號反饋到輸入端,就可構成一個多層的循環網絡。輸入的原始信號被逐步地加強、被修復。大腦的短期記憶

8、特征:看到的東西不是一下子就從腦海里消失的。穩定:反饋信號會引起網絡輸出的不斷變化。我們希望這種變化逐漸減小,并且最后能消失。當變化最后消失時,網絡達到了平衡狀態。如果這種變化不能消失,則稱該網絡是不穩定的。 2022/8/422循環網 第22頁,共72頁。人工神經網絡最具有吸引力的特點是它的學習能力。1962年,Rosenblatt給出了人工神經網絡著名的學習定理:人工神經網絡可以學會它可以表達的任何東西。人工神經網絡的表達能力大大地限制了它的學習能力。人工神經網絡的學習過程就是對它的訓練過程2022/8/423人工神經網絡的訓練 第23頁,共72頁。無導師學習(Unsupervised L

9、earning)與無導師訓練(Unsupervised Training)相對應 抽取樣本集合中蘊含的統計特性,并以神經元之間的聯接權的形式存于網絡中。2022/8/424無導師學習 第24頁,共72頁。有導師學習(Supervised Learning)與有導師訓練(Supervised Training)相對應。輸入向量與其對應的輸出向量構成一訓練。有導師學習的訓練算法的主要步驟包括:1) 從樣本集合中取一個樣本(Ai,Bi);2) 計算出網絡的實際輸出O; 3) 求D=Bi-O;4) 根據D調整權矩陣W; 5) 對每個樣本重復上述過程,直到對整個樣本集來說,誤差不超過規定范圍。 2022

10、/8/425 有導師學習 第25頁,共72頁。Widrow和Hoff的寫法:Wij(t+1)=Wij(t)+(yj- aj(t)oi(t)也可以寫成:Wij(t+1)=Wij(t)+Wij(t)Wij(t)=joi(t)j=yj- aj(t)Grossberg的寫法為: Wij(t)=ai(t)(oj(t)-Wij(t)更一般的Delta規則為: Wij(t)=g(ai(t),yj,oj(t),Wij(t)2022/8/426Delta規則 第26頁,共72頁。1 概述 2 基本BP算法 3 算法的改進 4 算法的實現 5 算法的理論基礎 6 幾個問題的討論 2022/8/427BP網絡第27

11、頁,共72頁。1、BP算法的出現非循環多級網絡的訓練算法UCSD PDP小組的Rumelhart、Hinton和Williams1986年獨立地給出了BP算法清楚而簡單的描述1982年,Paker就完成了相似的工作1974年,Werbos已提出了該方法2、弱點:訓練速度非常慢、局部極小點的逃離問題、算法不一定收斂。3、優點:廣泛的適應性和有效性。2022/8/428一 概述 第28頁,共72頁。4、BP網絡主要用于1)函數逼近:用輸入向量和相應的輸出向量訓練一個網絡逼近一個函數。2)模式識別:用一個特定的輸出向量將它與輸入向量聯系起來。3)分類:把輸入向量 以所定義的合適方式進行分類。4)數據

12、壓縮:減少輸出向量維數以便于傳輸或存儲。2022/8/429概述第29頁,共72頁。1 網絡的構成 神經元的網絡輸入:neti=x1w1i+x2w2i+xnwni神經元的輸出:2022/8/430二 基本BP算法 第30頁,共72頁。應該將net的值盡量控制在收斂比較快的范圍內可以用其它的函數作為激活函數,只要該函數是處處可導的2022/8/431輸出函數分析0.5f (net)0.25o0 11(0,0.5)net(0,0)o第31頁,共72頁。2022/8/432網絡的拓撲結構x1o1輸出層隱藏層輸入層x2o2omxnW(1)W(2)W(3)W(L)第32頁,共72頁。BP網的結構輸入向量

13、、輸出向量的維數、網絡隱藏層的層數和各個隱藏層神經元的個數的決定實驗:增加隱藏層的層數和隱藏層神經元個數不一定總能夠提高網絡精度和表達能力。BP網一般都選用二級網絡。2022/8/433網絡的拓撲結構 第33頁,共72頁。2022/8/434網絡的拓撲結構x1o1輸出層隱藏層輸入層x2o2omxnWV第34頁,共72頁。樣本:(輸入向量,理想輸出向量)權初始化:小隨機數與飽和狀態;不同保證網絡可以學。1、向前傳播階段:(1)從樣本集中取一個樣本(Xp,Yp),將Xp輸入網絡;(2)計算相應的實際輸出Op:Op=Fl(F2(F1(XpW(1)W(2)W(L)2022/8/4352 訓練過程概述

14、第35頁,共72頁。2、向后傳播階段 誤差傳播階段:(1)計算實際輸出Op與相應的理想輸出Yp的差;(2)按極小化誤差的方式調整權矩陣。(3)網絡關于第p個樣本的誤差測度:2022/8/4362 訓練過程概述 (4) 網絡關于整個樣本集的誤差測度:第36頁,共72頁。2022/8/4373 誤差傳播分析 1、輸出層權的調整wpq= wpq+wpqwpq=qop=fn (netq)(yq-oq)op=oq(1-oq) (yq-oq)op wpqANpANq第L-1層第L層wpq第37頁,共72頁。2022/8/4382、隱藏層權的調整 ANpANqANhvhppk-11kwp1wpqqkwpmm

15、k第k-2層第k層第k-1層第38頁,共72頁。2022/8/4392、隱藏層權的調整pk-1的值和1k,2k, ,mk 有關不妨認為pk-1通過權wp1對1k做出貢獻,通過權wp2對2k做出貢獻,通過權wpm對mk做出貢獻。pk-1= fk-1(netp) (wp11k+ wp22k+ wpmm k)第39頁,共72頁。vhp=vhp+vhp vhp=pk-1ohk-2 =fk-1 (netp)( wp11k+ wp22k+ + wpmmk)ohk-2=opk-1(1-opk-1)( wp11k+ wp22k+ + wpmmk)ohk-22022/8/4402、隱藏層權的調整ANpANqAN

16、hvhppk-11kwp1wpmqkwpqmk第k-2層第k層第k-1層第40頁,共72頁。基本BP算法neti=x1w1i+x2w2i+ +xnwni2022/8/441內容回顧第41頁,共72頁。2022/8/442內容回顧x1o1輸出層隱藏層輸入層x2o2omxnWV第42頁,共72頁。樣本權初始化向前傳播階段Op=Fn(F2(F1(XpW(1)W(2)W(n)誤差測度2022/8/443內容回顧第43頁,共72頁。向后傳播階段 誤差傳播階段輸出層權的調整wpq= qop =fn (netq)(yq-oq)op =oq(1-oq) (yq-oq)op隱藏層權的調整2022/8/444內容

17、回顧ANpANqANhvhppk-11kwp1wpqqkwpmmkvhp =opk-1(1-opk-1)( wp11k+ wp22k+ + wpmmk)ohk-2第44頁,共72頁。樣本集:S=(X1,Y1),(X2,Y2),(Xs,Ys) 基本思想 :逐一地根據樣本集中的樣本(Xk,Yk)計算出實際輸出Ok和誤差測度E1,對W(1) ,W(2) ,W(L)各做一次調整,重復這個循環,直到Ep do 4.1 E=0; 2022/8/446基本BP算法 第46頁,共72頁。 4.2 對S中的每一個樣本(Xp,Yp): 4.2.1 計算出Xp對應的實際輸出Op; 4.2.2 計算出Ep; 4.2.

18、3 E=E+Ep; 4.2.4 根據相應式子調整W(L); 4.2.5 k=L-1; 4.2.6 while k0 do 4.2.6.1 根據相應式子調整W(k); 4.2.6.2 k=k-1 4.3 E=E/2.0 2022/8/447基本BP算法第47頁,共72頁。1、BP網絡接受樣本的順序對訓練結果有較大影響。它更偏愛較后出現的樣本2、給集中的樣本安排一個適當的順序,是非常困難的。3、樣本順序影響結果的原因:分別依次4、用(X1,Y1),(X2,Y2), ,(Xs,Ys)的總效果修改W(1) ,W(2) , ,W(L)。w(k)ij=p w(k)ij2022/8/448算法的改進 第48

19、頁,共72頁。1 for k=1 to L do1.1 初始化W(k);2 初始化精度控制參數;3 E=+1;4 while E do 4.1 E=0;4.2 對所有的i,j,k: w (k)ij=0; 2022/8/449消除樣本順序影響的BP算法 第49頁,共72頁。4.3 對S中的每一個樣本(Xp,Yp):4.3.1 計算出Xp對應的實際輸出Op;4.3.2 計算出Ep;4.3.3 E=E+Ep;4.3.4 對所有i,j根據相應式子計算p w (L)ij;4.3.5 對所有i,j: w (L)ij= w (L)ij+p w (L)ij;4.3.6 k=L-1;4.3.7 while k0

20、 do4.3.7.1 對所有i,j根據相應式子計算p w (k)ij;4.3.7.2 對所有i,j: w (k)ij= w (k)ij+p w (k)ij;4.3.7.3 k=k-1 4.4 對所有i,j,k:w (k)ij= w (k)ij+ w (k)ij;4.5 E=E/2.0 2022/8/450第50頁,共72頁。較好地解決了因樣本的順序引起的精度問題和訓練的抖動問題 收斂速度:比較慢偏移量:給每一個神經元增加一個偏移量來加快收斂速度 沖量:聯接權的本次修改要考慮上次修改的影響,以減少抖動問題 2022/8/451算法分析 第51頁,共72頁。主要數據結構WH,m 輸出層的權矩陣;V

21、n,H 輸入(隱藏)層的權矩陣;m輸出層各聯接權的修改量組成的向量;H隱藏層各聯接權的修改量組成的向量;O1隱藏層的輸出向量;O2輸出層的輸出向量;(X,Y)一個樣本。 2022/8/452 算法的實現 第52頁,共72頁。用不同的小偽隨機數初始化W,V;初始化精度控制參數;學習率 ; 循環控制參數E=+1;循環最大次數M;循環次數控制參數N=0; while E & N0,此時wij0取E0wij第59頁,共72頁。2022/8/460最速下降法,要求E的極小點而其中的 所以, 第60頁,共72頁。2022/8/461最速下降法,要求E的極小點令所以wij=joi為學習率第61頁,共72頁。oj=f(netj) 容易得到 2022/8/462ANj為輸出層神經元 從而 第62頁,共72頁。2022/8/463ANj

溫馨提示

- 1. 本站所有資源如無特殊說明,都需要本地電腦安裝OFFICE2007和PDF閱讀器。圖紙軟件為CAD,CAXA,PROE,UG,SolidWorks等.壓縮文件請下載最新的WinRAR軟件解壓。

- 2. 本站的文檔不包含任何第三方提供的附件圖紙等,如果需要附件,請聯系上傳者。文件的所有權益歸上傳用戶所有。

- 3. 本站RAR壓縮包中若帶圖紙,網頁內容里面會有圖紙預覽,若沒有圖紙預覽就沒有圖紙。

- 4. 未經權益所有人同意不得將文件中的內容挪作商業或盈利用途。

- 5. 人人文庫網僅提供信息存儲空間,僅對用戶上傳內容的表現方式做保護處理,對用戶上傳分享的文檔內容本身不做任何修改或編輯,并不能對任何下載內容負責。

- 6. 下載文件中如有侵權或不適當內容,請與我們聯系,我們立即糾正。

- 7. 本站不保證下載資源的準確性、安全性和完整性, 同時也不承擔用戶因使用這些下載資源對自己和他人造成任何形式的傷害或損失。

最新文檔

- 2025授權合同 房地產評估委托協議書

- 山東省日照市莒縣第三中學教育集團2024-2025學年九年級下學期第一次月考數學試題(含簡單答案)

- 專業英語 Unit 16教案學習資料

- 《人類的“老師”》課件

- 房產公司安全培訓學習

- 江蘇省連云港市城頭高級中學2024-2025學年高二下學期第一次質量檢測政治試題(原卷版+解析版)

- 保險行業工作計劃

- 保險行業開門紅早會主持詞

- 現代藝術未來科技人文住宅景觀方案投標項目

- 《宮頸病變》課件大綱

- 【基于UASB+SBR的組合處理工藝的制藥廠廢水處理工藝設計12000字】

- 手術室對病理標本處置出現錯誤的原因分析品管圈魚骨圖柏拉圖

- 澳洲堅果雪花酥加工技術規程

- 小升初個人簡歷模板下載

- 6款課堂活動隨機點名-抽獎模板(可編輯)兩套

- 牛產后疾病課件

- 無人機在公安領域的應用

- 生產建設項目土壤流失量測算導則計算程序

- 5G共址基站電磁輻射投訴監測實例分析與討論

- 16-第六章-污染事故應急GIS-資源環境信息系統課件

- 慢性心力衰竭“新四聯”藥物治療臨床決策路徑專家共識(2022年)解讀

評論

0/150

提交評論